Diapositive 1 : (Titre)

(Identique au titre)

Bruit humain, filtres de l’IA

Eryk Salvaggio

24 mai 2025 – Jeu de Paume, Paris

Diapositive 2 : Watson et Bell

Je souhaiterais commencer par un nouveau mythe du bruit : l’histoire de Thomas Watson, l’assistant de laboratoire d’Alexander Graham Bell. Avant même l’invention de la radio, Watson entretenait une relation singulière avec le son des transmissions. Dans ses carnets, il se décrit veillant tard dans la nuit, l’oreille collée au haut-parleur d’essai — à l’écoute des bruits étranges circulant dans les fils. Hillel Schwartz, dans un passage de son ouvrage monumental Making Noise, imagine les réflexions nocturnes de Watson :

Diapositive 3 : Making Noise

« Ce craquement, suivi d’un grincement — était-ce la conséquence d’une explosion à la surface du soleil ? Ce pépiement, semblable à celui d’un oiseau, était-il un signal venu d’une planète lointaine ? Quelles forces occultes étaient donc à l’œuvre, perceptibles à peine, dans les replis du son téléphonique ? » (Making Noise, p. 330)

J’étais dans une position similaire lorsque j’ai commencé à travailler avec des enregistrements de terrain générés par IA et les bruits ambiants de pièces vides. Je me suis surpris à scruter intuitivement ces ambiances, à la recherche d’indices de ce qui se passait dans ces poches de l’espace latent — tentant d’en deviner la forme, la présence, à travers la tonalité du bourdonnement.

Bien sûr, il n’y avait pas de pièces. Aucun stylet n’inscrivait de vibrations sur des cylindres de cire. Aucune tête de lecture n’aimantait des bandes audio. Il n’y avait personne dans la pièce : il n’y avait pas de pièce. Le son généré par un modèle de diffusion ne fait qu’approcher un bruit de fond : une imitation sonore — un perroquet stochastique, au sens le plus littéral.

Pour Watson, le bruit dans le fil était une amplification du cosmos, les soubresauts d’événements cosmiques échappant à sa compréhension. Un effet résiduel d’une immensité fantastique laissant ses traces dans un morceau de cuivre et quelques aimants. C’était une boîte noire, elle aussi, qui, peut-être un jour, deviendrait identifiable — à condition d’écouter suffisamment bien. Quelle surprise, quelle satisfaction, quelle étrangeté cela a dû être, alors, pour Watson, ce jour fatidique où le bruit du cosmos a cédé la place à une voix : la voix d’un technologue, l’appelant par son nom, assortie d’une demande simple :

Diapositive 4

« Monsieur Watson, venez ici, j’ai besoin de vous. »

Aujourd’hui, nous sommes tous des assistants de laboratoire à notre insu, collectant des données pour les fils invisibles dans l’espoir d’être vus par la machine. En retour, les machines répètent nos noms, nous séduisant par un appel semblable :

Diapositive 5

« Utilisateur, viens ici ; je veux te voir. »

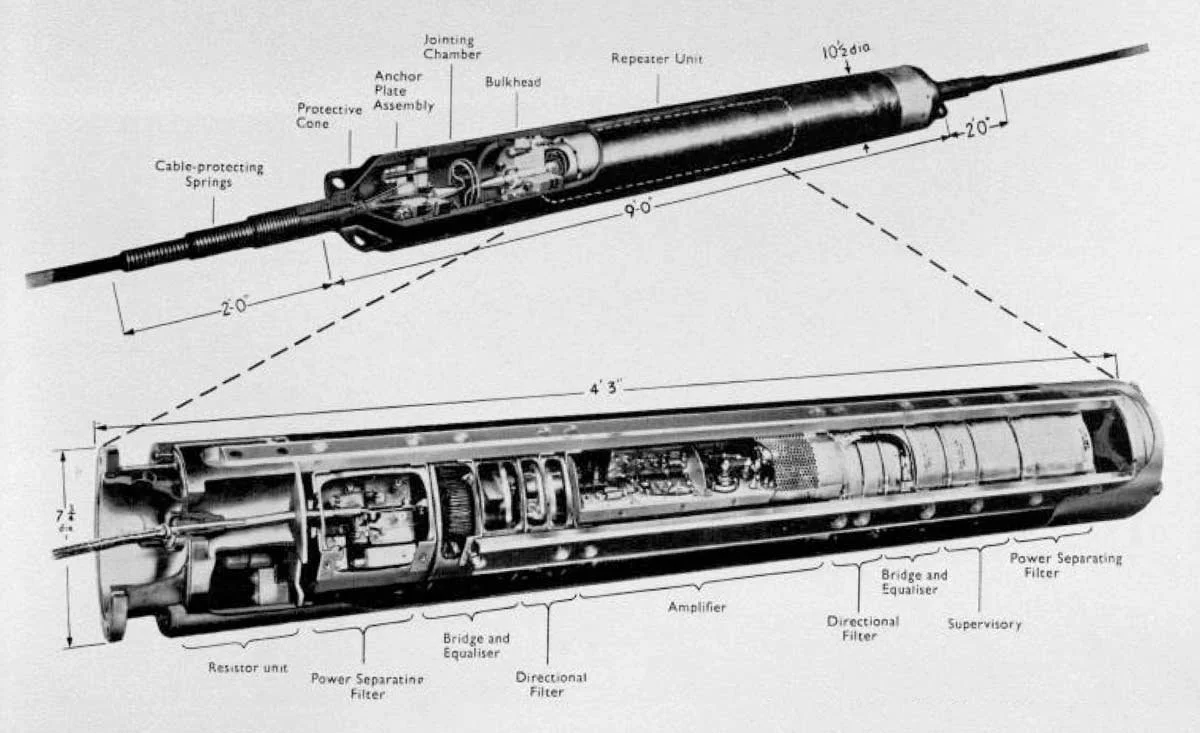

Diapositive 6 : Câble sous-marin

Toute forme d’émerveillement face à ce bruit dans le fil a rapidement cédé la place à un usage utilitaire : éliminer le monde du canal pour que les humains puissent l’occuper pleinement. Pour permettre à la technologie de fonctionner dans des conditions parfaites, d’immenses réseaux de câbles devaient être isolés de tout événement extérieur. Cela pouvait être le vent secouant la ligne, ou des arbres sectionnant un câble. Cela pouvait être une saturation des signaux, lorsque des voix isolées franchissaient leurs barrières, produisant ce qu’on appelle des interférences — ou cross-talk. Cela pouvait aussi être des radiations solaires. Ou encore la foudre.

Diapositive 7 : Nuage

Aujourd’hui, le monde des fils s’est dissous dans les réseaux sans fil, que les commerciaux des données nomment un cloud. Ils nous offrent ainsi une sensation trompeuse d’immatérialité, à l’image de notre illusion croissante d’anti-corporéité. Le centre de données n’existe pas, nous dit-on, tout comme on nous affirme que l’intelligence n’a pas besoin de corps.

Diapositive 8 : Tortue

La lutte pour définir le bruit et le signal se prolonge jusque dans la théorie de conception des systèmes d’intelligence artificielle. Ces systèmes sont issus d’un neurone simple : allumé ou éteint, un ou zéro, un rayon lumineux qui traverse le trou d’une carte perforée ou qui s’y heurte. Les premiers robots, comme la tortue de Grey Walter, se dirigeaient vers la lumière et s’arrêtaient dans l’obscurité. Le zéro et le un divisaient le monde en deux catégories : le un, une mesure lisible ; le zéro, une absence de lisibilité. Dire qu’un un représente un signal et qu’un zéro représente du bruit est une simplification, mais le zéro est bel et bien l’absence de signal électrique.

Les réseaux sociaux ont d’abord joué un rôle d’observateur silencieux, comme les algorithmes de compression dans un fil téléphonique. Très vite, le fil avait suffisamment observé, et les algorithmes ont pu prédire et sculpter les conditions d’amplification de nos signaux. À l’ère de la voix de l’IA dans le fil — « Utilisateur, viens ici ; je veux te voir » — nous sommes sommés de produire un signal, et récompensés par un pic de dopamine lorsque nous y parvenons. Le signal fort traverse le fil du réseau social ; le signal faible, lui, reste figé.

Diapositive 9 : Espace vectoriel

« Utilisateur, viens ici ; je veux te voir. »

Mais que signifie être vu ? Le travail de Sara Ahmed, dans The Promise of Happiness, est utile ici : elle parle de l’appel au nom dans la honte familiale. « C’est pour ton bien », dit-on. Une phrase qui détient un pouvoir coercitif, où l’enjeu n’est pas votre bien-être, ni votre identité, mais la nécessité de contrôle. Pour ce parent — et pour les algorithmes de l’IA, qui nous « voient » de manière comparable —, l’enfant problématique n’est pas vu, mais mesuré, comparé, évalué, classifié. Si la catégorie assignée est conforme, l’enfant difficile est invité à participer à l’hospitalité du parent — ou de la plateforme. Mais si vous trahissez la catégorie, ou si vous êtes illisible pour le système de mesure, vous n’êtes pas un signal. Vous êtes du bruit.

La théoricienne américaine Sarah Watkins Fisher décrit la position des artistes des médias critiques comme une forme de « résistance parasitaire ». Elle suggère que ces artistes agissent comme des parasites sur l’hospitalité de ces systèmes. Nous négocions en permanence entre résistance et complicité, en testant les limites de ce qui est permis au sein d’un système, afin de subvertir ou de révéler les règles et les frontières de cette hospitalité.

L’IA prolonge une certaine forme de cette hospitalité des plateformes. Elle nous l’offre via ses interfaces et ses mythes sur ce que la technologie peut faire pour nous, tout en effaçant soigneusement la source de ce pouvoir — qui réside, bien souvent, dans les utilisateurs eux-mêmes. L’IA nous invite dans ses résumés du Web, distillant d’innombrables perspectives issues de diverses pages en une seule voix autoritaire. Dans le domaine artistique, nous savons désormais que les données d’entraînement récupèrent les matériaux des artistes, les reconditionnent et les revendent à d’autres utilisateurs.

Diapositive 10 : Bruit

Le bruit, en tant que métaphore, intervient dans les systèmes d’IA de multiples façons. Je vais en citer trois. Premièrement, il y a l’architecture du modèle. Et ici, ce n’est pas une métaphore : les modèles de diffusion ont besoin de bruit pour fonctionner.

Diapositive 11 : Shrimp Jesus

Deuxièmement, ce que j’appelle l’infrastructure de la bouillie (Slop Infrastructure) : la capacité des IA à produire, à grande échelle, une amplification de la culture algorithmique qui noie les signaux spécifiques au profit de signaux simplement plausibles — créant une mer de bruit où toute communication authentique devient presque impossible.

Diapositive 12 : Elon Musk

Troisièmement, l’IA est une structure politique, comme on a pu le constater récemment avec la prise de contrôle par Elon Musk de l’administration américaine à travers la plateforme DOGE. L’industrie de l’IA nous impose ces technologies dans une volonté de résoudre les tensions de la politique : une manière d’éliminer les désaccords, les débats, la délibération — toutes les dimensions désordonnées mais essentielles de la démocratie.

J’ai déjà traité ces sujets dans d’autres contextes. Mais aujourd’hui, puisque nous sommes ici pour parler de création contemporaine, je souhaite aborder le bruit en tant que matière artistique, de manière concrète. Mon intérêt pour le bruit s’appuie sur ces définitions, et en fait pour moi un matériau puissant — un levier d’une pratique critique de l’IA.

Diapositive 13 : Bruit

Lorsqu’un modèle de diffusion génère une image, il commence par du bruit aléatoire — une séquence en cascade de valeurs arbitraires de rouge, vert et bleu. Ces pixels sont comparés à ce que vous avez décrit dans votre prompt. Si le modèle de diffusion perçoit du bruit, il est conçu pour le supprimer.

Il le supprime en introduisant d’abord les contours de haut niveau correspondant aux images reliées à votre prompt. Ensuite, il commence à affiner les détails. La plupart des modèles procèdent en évaluant chaque état de l’image via un système de reconnaissance d’images. CLIP est l’un de ces systèmes : un modèle de vision par ordinateur. CLIP examine l’image à chaque étape de génération pour déterminer s’il s’agit de bruit — c’est-à-dire d’une image méconnaissable — ou si l’image se rapproche du prompt.

Diapositive 14 : Neurones régionaux

Pour illustrer cela, on peut observer cette image, qui montre ce que CLIP cherche dans les images étiquetées « Australie ». Pour générer une image à partir de bruit, celle-ci doit d’abord ressembler à une forme que CLIP « attend ». Ensuite seulement, l’image peut passer. CLIP est donc un filtre.

Diapositive 15 : Koalas

Si vous demandez une image d’« une personne typiquement australienne », vous obtenez des koalas — car CLIP reconnaît une forme apparentée à un koala dans ce qu’il identifie comme « australien ».

Diapositive 16 : Chats, chiens et bruit

Les colorations, les formes, et ainsi de suite, de cette génération initiale structurent les images produites par les IA génératives. C’est cette structuration qui m’intéresse dans la relation entre IA et culture visuelle. Ce que nous faisons, avec les images générées par IA, c’est structurer du bruit à travers l’attribution de catégories. Ces catégories existent dans ce qu’on appelle l’espace latent ou, lorsqu’on parle du stockage mathématique des combinaisons de pixels possibles, dans l’espace vectoriel. Mais cet espace vectoriel est souvent présenté comme générant des possibilités infinies — comme si les vecteurs, c’est-à-dire la structure même de la recherche de motifs mathématiques, donnaient forme à cette infinité.

C’est, fondamentalement, une mauvaise lecture de ce que fait l’espace vectoriel. L’espace vectoriel contraint les possibilités infinies du bruit, car ces possibilités infinies ressemblent à du bruit, mais pas à des images. Nous contraignons donc le bruit aux motifs d’images préexistantes dans le jeu de données, pour le faire conformer à ces données. Ces motifs doivent pouvoir être reconnus comme des images plausibles par CLIP. La plausibilité vient du fait d’greffer les motifs d’un chat sur une tache floue, ou ceux d’un chien sur un autre flou, et ainsi de suite.

Diapositive 17 : Taxidermie

« Mon système de génération d’images, qui tend vers des résultats visuellement cohérents, de type artistique ou photographique, n’est pas optimisé pour les motifs purement mathématiques ou abstraits comme le bruit gaussien. Il cherche à donner du sens, à produire une forme. Or, le bruit gaussien, étant une variation aléatoire de l’intensité des pixels selon une distribution normale, ne fournit pas ce type de structure. Quand je (ici, ChatGPT) l’ai invité (c’est-à-dire, ChatGPT image) à générer ce bruit, il a probablement “bloqué”, en tentant de concilier cela avec ses modèles habituels de ce à quoi une image est censée ressembler. »

Diapositives 20, 21, 22, 23 : Images de bruit

Alors, à quoi une image est-elle censée ressembler ? Certainement pas à ceci.

Car voilà ce qui se passe quand on demandait à Stable Diffusion de générer une image de bruit, fin 2022. En termes stricts, ce n’est pas du bruit — du moins, pas du bruit gaussien.

C’est une question qu’on me pose souvent, donc je veux y répondre clairement. Je ne génère pas une image de bruit à partir des données d’entraînement. Ce n’est pas une représentation du bruit dans l’espace latent. Ce que vous voyez, c’est un modèle qui commence avec une image de bruit, puis tente de déplacer ce bruit vers ce que vous avez indiqué dans le prompt.

Diapositive 23 : Bruit et cercles dans les champs

S’il se dirigeait vers l’image d’un chat, il produirait une image de chat. CLIP interviendrait pour estimer, par exemple, une probabilité de 10 % que ce soit un chat. À partir de là, le système commencerait à « nettoyer » le bruit pour le rapprocher d’une représentation photographique d’un chat.

Mais ici, je demande une image de bruit. Lorsque CLIP observe la première image générée, il dit : oui, c’est du bruit. Sauf qu’il reste encore environ 70 étapes. Ce chiffre est ajustable, mais par défaut, il y a souvent 70 étapes, pendant lesquelles le système tente d’ajouter du détail à ce bruit. Au fur et à mesure que ce détail s’accumule, CLIP commence à dire : ceci n’est plus du bruit. Et paradoxalement, dans un modèle génératif, cela devient le signal d’ajouter à nouveau du bruit — pour pouvoir, ensuite, « le nettoyer » dans une autre direction, plus détaillée.

Autrement dit, on introduit un glitch. On introduit une friction entre une définition fondamentalement instable du bruit et la recherche de motifs dans ce bruit — des motifs qui contredisent la direction du prompt. On aboutit, après ces 70 étapes, à des images abstraites qui ressemblent à celles que vous voyez ici.

Ces images sont, pour moi, un geste esthétique vers ce qui résiste à la catégorisation nécessaire à la production d’une image par l’IA. Le bruit inonde la structure, submerge sa logique avec une logique contradictoire.

Diapositive 24 : Ailes de bruit

Je trouve ces images fascinantes en tant qu’artefacts — elles sont pour moi une matière exploitable : une forme symbolique représentant ce qui est inconcevable à l’intérieur même de la structure de l’espace latent. C’est, en un sens situationniste, une photographie d’un échec : celui d’une machine à résoudre le paradoxe de définir le bruit contre lui-même.

Car au fond, les seules choses véritablement génératives que les machines produisent sont leurs erreurs.

Il y a quelque chose, dans le bruit, qui touche au rôle politique de l’IA dans le moment actuel. La stratégie DOGE d’Elon Musk mobilise l’IA aux États-Unis pour éradiquer le bruit de la démocratie — c’est-à-dire pour prendre des décisions sur la distribution des ressources, sur la circulation du pouvoir, et sur ses destinataires. Mais cela n’est que l’exemple le plus visible d’une impulsion techno-solutionniste : celle de réduire le bruit en structures maîtrisables.

Le bruit, alors, ne fait pas que résister à l’impulsion machinique de la contrainte. Il est la définition même de ce qui résiste à être modélisé par cette idéologie politique de la catégorisation binaire — du 1 et du 0. Le bruit est ce qui vit au-delà de ce que les vecteurs peuvent réguler. Dans les modèles de diffusion, il représente le monde incompressible, situé au-delà du jeu de données, au-delà du signal réductible.

Diapositive 25 : Citation

« Le bruit est ce qui échoue toujours à entrer dans une définition. La question du bruit, et de qui a le droit de le définir, se trouve au cœur de la lutte de pouvoir entre générations successives, entre hégémonie et innovation. Le bruit est présent à la fois dans le vacarme des masses ignorées et dans le tumulte incessant du progrès et de la construction du nouveau. Il se trouve dans la diversité et la confrontation avec l’inconnu, l’autre, l’étrange. Le bruit est aussi dans les structures de contrôle et de domination, autant que dans l’échec de ces systèmes — dans leur incapacité à être holistiques ou totalisants. Mais malgré toutes ces formes, le bruit n’est pas une consonance des contraires : c’est une unité troublée, une unité qui ne se synthétise jamais totalement. » — Aaron Zwintscher, Noise Politics, 2019

Je mets cette idée du bruit en contraste avec une logique organisationnelle propre à l’IA, celle que Marvin Minsky a explorée avec le concept de schéma (schema). Un schéma, c’est une attente : une structure mentale qui nous aide à organiser le monde de manière efficace. Par exemple, nous avons tous une idée de ce à quoi une fête d’anniversaire est censée ressembler. Ainsi, lorsque nous y allons, nous avons une anticipation de ce que nous allons y trouver. Mais une fois sur place, c’est toujours différent, car nous ne pouvons pas prédire le futur — et un schéma, ce n’est pas une prédiction.

Diapositive 26 : Minsky

Minsky écrit :

« Lorsqu’on rencontre une nouvelle situation (ou qu’on modifie en profondeur sa perception d’un problème), on sélectionne dans sa mémoire une structure appelée cadre (frame). C’est une structure mémorisée qu’on adapte à la réalité en modifiant les détails nécessaires. Un frame est une structure de données permettant de représenter une situation stéréotypée, comme se trouver dans un certain type de salon ou assister à la fête d’anniversaire d’un enfant. À chaque frame sont associés plusieurs types d’informations. Certaines concernent son utilisation. D’autres indiquent ce que l’on peut attendre comme événements à suivre. D’autres encore indiquent quoi faire si ces attentes ne sont pas confirmées. »

C’est une hypothèse fondée sur des attentes, mais qui entre parfois en conflit avec la réalité. Voilà l’un des malentendus fondamentaux dans la manière dont l’IA est présentée aujourd’hui : on suppose que la machine comprend le monde dès lors qu’elle possède un schéma. Aujourd’hui, on appelle cela un modèle du monde.

En contraste, l’humain, en particulier dans le champ de la psychanalyse, vit des conflits entre ces schémas et la présence débordante de l’information — ce que Cécile Malaspina nomme une « liberté de choix écrasante », où le bruit est omniprésent.

Diapositive 27 : Anniversaire

Les schémas contraignent le bruit du monde. Ils réduisent toutes les possibilités que pourrait contenir une fête d’anniversaire à un modèle simplifié, flou, basé sur l’expérience passée.

Le problème de l’IA générative, tel que je le vois, c’est qu’on croit qu’en arrivant au bon schéma, on fabrique un outil qui reflète nos capacités humaines. Mais ce n’est pas ce que font nos schémas humains.

Diapositive 28 : Anniversaire 2

Les schémas n’ont jamais eu vocation à être les limites de notre expérience. Nous sommes censés les négocier, les remettre en question, les abandonner, les adapter. Arriver à un schéma — lorsqu’une image nous est renvoyée en réponse à un prompt —, c’est s’arrêter trop tôt dans l’exploration du monde réel, avec toute sa complexité et ses transformations infinies.

C’est renoncer à imaginer un autre type de fête d’anniversaire.

Diapositive 29 : Anniversaire 3

Je ne veux pas exagérer mon propos. Il ne s’agit pas de dire que nous sommes des utilisateurs passifs, incapables de négocier une relation avec le système.

Au contraire : je soutiens précisément que c’est possible — et que par l’usage créatif détourné des systèmes d’IA, par des stratégies de réappropriation, de subversion ou de glitch, les artistes modèlent de nouvelles relations.

Des relations qui nous éloignent d’une dépendance aux affordances (fonctionnalités suggérées) des modèles, et donc du pouvoir que ces interfaces exercent sur les utilisateurs.

Diapositive 30 : Citation sur le bruit (Malaspina)

Les images de bruit, à cet égard, représentent des aperçus de possibilités encore impossibles à modéliser — des rappels, ou même des artefacts, d’une confrontation computationnelle avec ce que la machine ne peut toujours pas imaginer : une simple agitation de pixels, à un niveau de détail assez fin.

Le modèle est limité, surdéterminé par son programme, mécaniste — et il ne peut reconsidérer sa position quant à ce qu’est une image de bruit.

Il est à jamais enfermé dans le point de contrôle de son entraînement, et toutes les possibilités qu’il génère sont issues de ces schémas. Il n’a même pas conscience de leur existence ni de leur lien avec ce qu’il produit.

Diapositive 31 : Watson

Et nous revenons alors à Thomas Watson, qui écoutait si attentivement le bruit dans le fil, juste avant d’être appelé dans la pièce voisine.

Mais qu’aurait-il entendu s’il n’avait pas entendu son nom ? Quelles possibilités auraient émergé de l’échec de cette transmission vocale ?

Une fois l’outil défini comme une technologie de transmission vocale, notre imagination pour cet appareil d’écoute — qui pouvait autrefois capter les résidus inexplicables du rayonnement cosmique — est devenue obsolète. Je veux élargir notre imagination quant aux finalités possibles de ces systèmes.

C’est là, pour moi, que réside la véritable imagination créative : non pas dans la structure surdéterminée du processus mécaniste, mais dans la capacité à se tenir en dehors des définitions, et à imaginer les possibles qui demeurent en suspens, latents, au-delà d’elles.

Diapositive 32 : Moth Glitch

Il me reste peu de temps, alors je souhaiterais montrer un film — un film réalisé à partir de ces images de bruit dans un modèle de diffusion vidéo, superposées à des papillons de nuit. Un rappel du tout premier bug informatique : en 1948, une panne dans les ordinateurs de l’Université Harvard fut causée par un papillon de nuit coincé dans le câblage.

Vingt ans plus tard, le cinéaste Stan Brakhage réinventait les méthodes et les matériaux du cinéma en collant sur pellicule les insectes morts qu’il trouvait dans son camp — épuisés, tombés pendant la nuit après avoir volé en boucle contre une ampoule. Un glitch interne, évoquant les boucles dopaminergiques des réseaux sociaux.

Dans ce film, Moth Glitch, la matérialité de ces bugs visuels de l’IA rencontre l’impossibilité de produire un vrai papillon — il ne nous reste que les manifestations détraquées de millions de papillons, vus, peut-être, depuis une autre pièce.